Innehåll

- Certifiering steg för steg

- Advanced Level Syllabus - Test Manager

- Testprocessen

- Testledning

- Granskningar

- Defekthantering

- Förbättra testprocessen

- Testverktyg och -automatisering

- Testkunskaper och lagarbete

- Expert Level Syllabus - Test Manager

- Förbättra testprocessen

- Modellbaserade förbättringar

- Analysbaserade förbättringar

- Välja rätt ansats för testförbättringar

- Genomföra testförbättringar

- Organisation, roller och färdigheter

- Hantera förändring

- Kritiska framgångsfaktorer

- Anpassning till olika livscykelmodeller

- The Expert Test Manager

- Quality Center / ALM

- Översikt

- Förbered ALM

- Arbeta i ALM

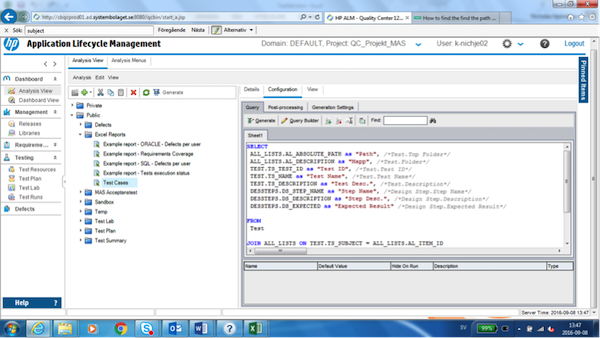

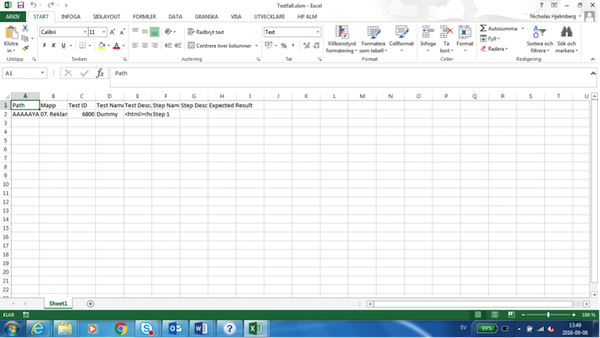

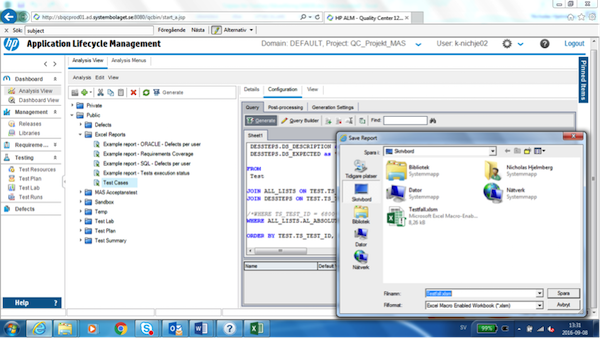

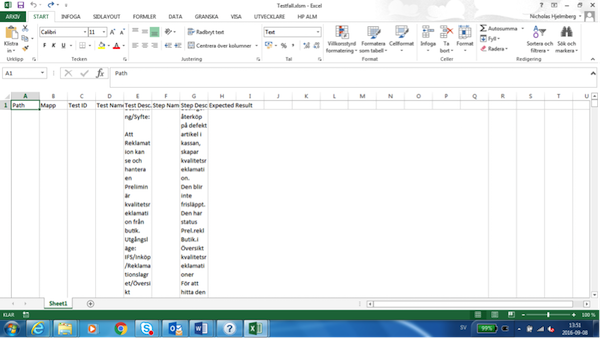

- Exportera testfall från QC till Excel

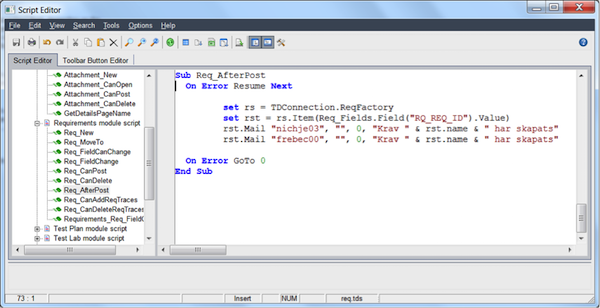

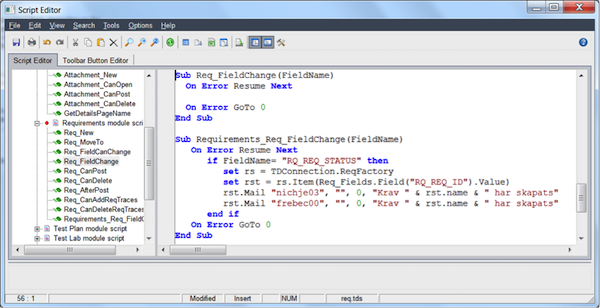

- Mejl från QC

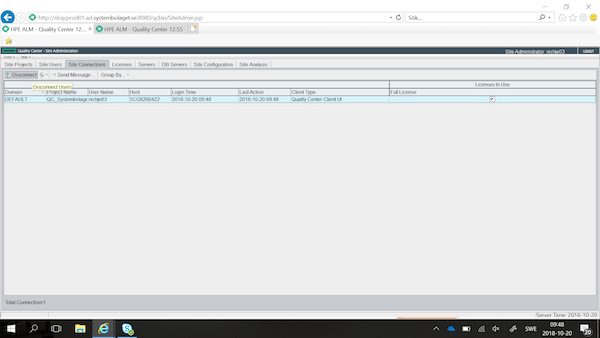

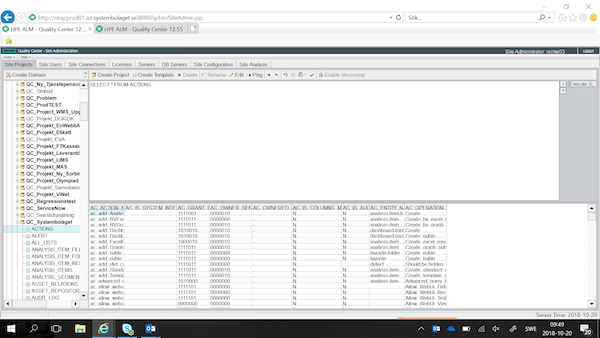

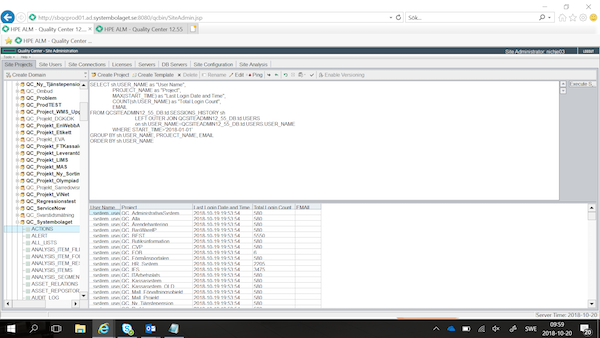

- ALM Site Administrator

- Tips om ALM

- The Quality Dilemma

- The Quality Concept

- The Requirements

- Quality vs Time and Cost

- The Quality Dilemma

- The Ten Tester Commandments

- Kvalitet i agila projekt

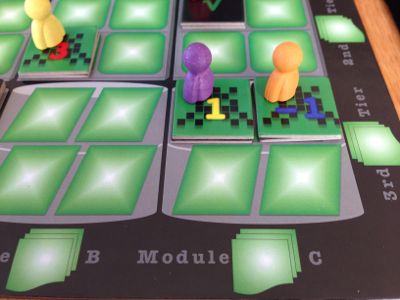

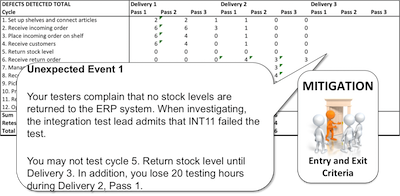

- Learning by Gaming

- Testing Methodology Applied to Games

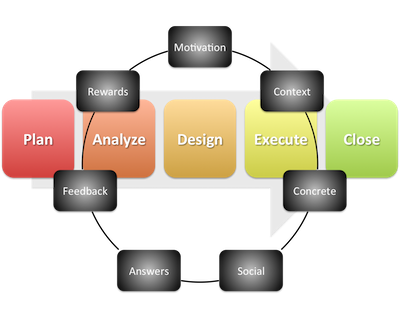

- The Test Process

- Planning and Control

- Analysis

- Design

- Implementation

- Execution

- Evaluation and Closure

- Testification - Learn Testing through Gamification (Abstract)

- Testification - Learn Testing through Gamification (Full text)

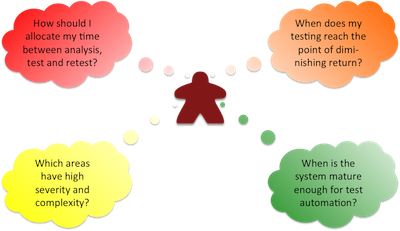

- Know Thyself

- Don't Learn how to Do, Learn how to Think

- Encourage Creative Thinking

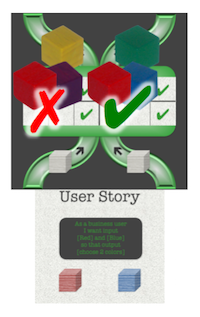

- Represent Test through Games

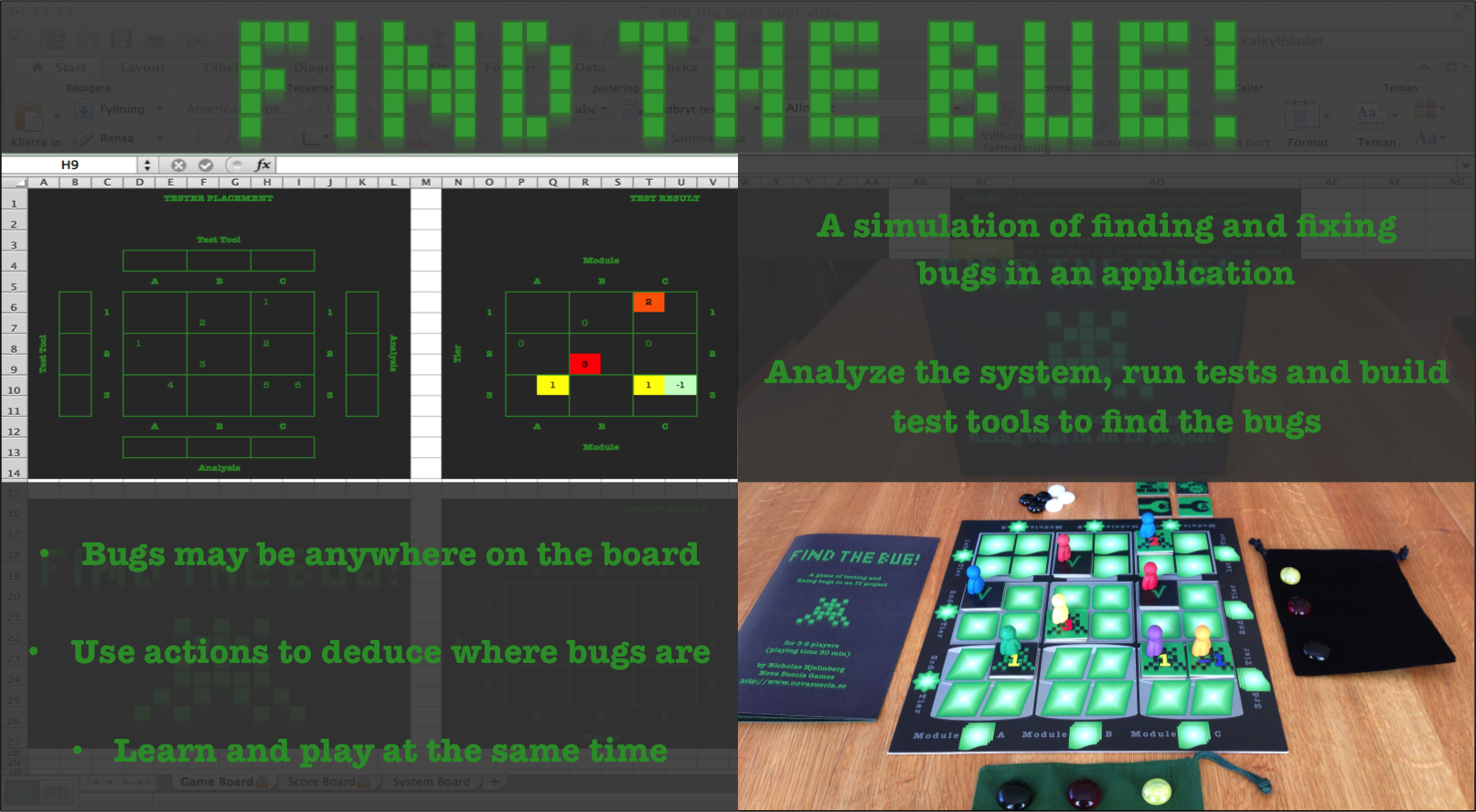

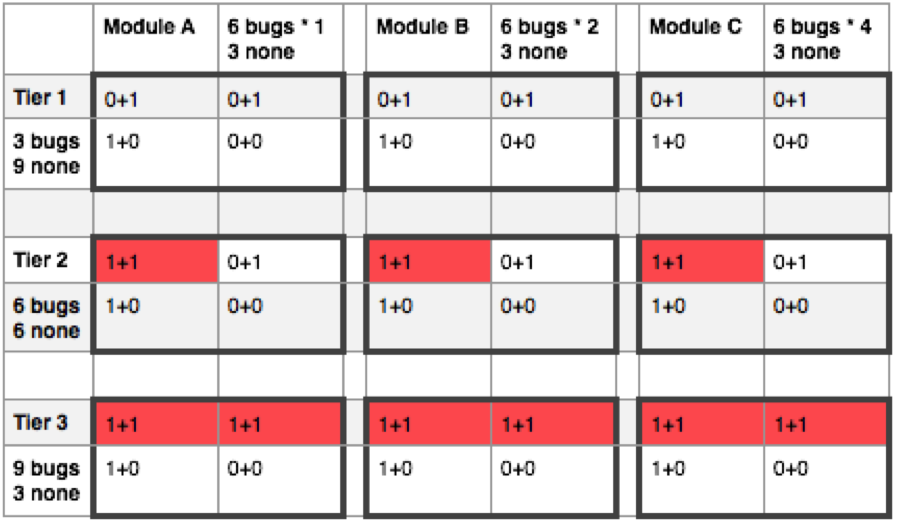

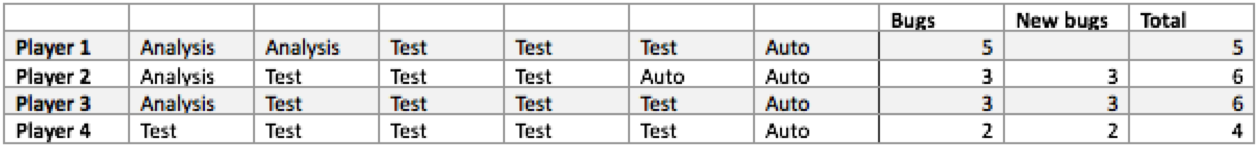

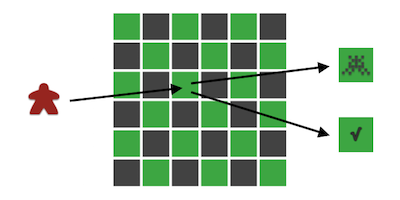

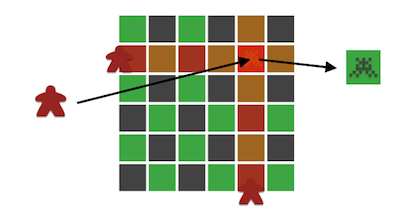

- Find the Bug!

- Find the Bug! Agile

- Learn the Experience of a Tester

- Plan with the End in Mind

- Analyze with a Quality Mindset

- Test the Right Things and Test Things Right

- Execute as Planned and Replan Execution

- Close when Everything is Properly Packed

- Conclusion

Testledning

Uppdaterad 2018-09-30

Nytt år och ny certifiering. I fjol certifierade jag mig inom PMP och i år tänkte jag ge mig på ISTQB Expert Level Test Manager.

ISTQB står för International Software Testing Qualifications Board, en ideell organisation som syftar till att definiera och samla kunskap om test, certifiera testare baserat på best practices, knyta samman testare världen över samt uppmuntra forskning och utveckling. ISTQB är en välkänd organisation och en certifiering på CV:t närmast ett måste för den som vill göra karriär inom test.

Det bör påpekas att test är ett svagt definierat område med få etablerade standarder och att du inte bara kan ta med dig din verktygslåda till en ny kund och börja testa. Det hjälper inte att vara expert på ett område om du inte kan förstå och göra dig förstådd i resten av projektet. Som konsult har jag behövt lära mig varje ny kunds syn på test och "översätta" deras vokabulär till min egen för att kunna prestera. Lyhördhet, tydlighet och pragmatism är tre nyckelord för att lyckas.

Därmed inte sagt att en certifiering är meningslös. Tvärtom ger den dig många nya insikter och idéer som, om du lyckas integrera dem i ditt testarbete, gör dig till en ännu bättre testare. Precis som jag gjorde när jag studerade till PMP ämnar jag därför knyta samman teori och praktik och relatera det jag lär mig till det jag gör (eller borde ha gjort). Men låt oss börja från början.

Certifiering steg för steg

Certifieringskrav

För en certifiering som ISTQB Expert Level Test Manager krävs följande:

- ISTQB Foundations-certifiering

- ISTQB Advanced-certifiering (test manager)

- Minst 75% rätt på examen

- 5 års erfarenhet av test (kan tas efter examen)

- 2 års erfarenhet av testledning (kan tas efter examen)

- Minst en publikation eller en presentation på en testkonferens om testledning (kan tas efter examen)

Se ISTQB:s hemsida för detaljer.

Studera

För att studera till examen rekommenderas följande böcker. De uppdateras regelbundet så var noga med att studera de allra senaste utgåvorna.

- Expert Level Syllabus - Test Management: ISTQB:s officiella kvalificeringskrav för certifieringen, en detaljerad sammanställning men utan verklighetsnära exempel

- Advanced Level Syllabus - Test Manager: Kvalificeringskrav för nivån under Expert (särskilt kapitel 8 om standarder och testförbättringar)

- Foundation Level Syllabus: Kvalificeringskrav för nivån under Advanced

- The Expert Test Manager av Rex Black och Debra Friedenberg: En av (än så länge) få böcker om expertnivån med 500 sidor teori, övningar och exempelfrågor

Det är dessa böcker som jag nedan kommer att sammanfatta och reflektera över.

Boka examen

Examen kan bokas antingen hos SSTB eller hos någon som erbjuder kursen. (Examen kan tas i samband med kurs eller med enbart självstudier.)

Ta examen

Examen består av två delar:

- En flervalssektion om 20 frågor. Skrivtiden är en timme. Denna del mäter de så kallade K-nivåerna 1-4 (komma ihåg, förstå, praktisera och analysera).

- En essädel om 5 frågor, varav 4 väljs. Du får läsa en fallbeskrivning i 30 minuter och sedan skriva essäer i 2 timmar. Denna del mäter de så kallade K-nivåerna 5-6 (utvärdera och skapa)

Underhåll certifieringen

Certifieringen gäller i fem år. Efter denna tid måste du antingen ta en ny examen eller uppnå minst 200 så kallade CEC (Certification Extension Credits). CEC kan erhållas lite som PMI-certifieringens PDU, alltså genom att arbeta som testledare, delta i testkurser eller själv hålla i testkurser. Bevis på CEC måste skickas till The Certification Extension Program hos ISTQB men i skrivande stund är denna process inte fastställd ännu.

Advanced Level Syllabus - Test Manager

Låt oss börja med att repetera Advanced Level Syllabus - Test Manager. Observera att det finns tre spår på Advanced-nivån och att Test Manager har en egen Syllabus fr o m 2012. Tidigare (2007) fanns det bara en Syllabus där de tre spåren omfattade olika kapitel. Om du, liksom jag, studerade den gamla versionen när du tog Advanced-certifieringen så bör du läsa igenom den nya versionen till din Expert-certfiering.

1. Testprocessen

Advanced Level Syllabus börjar med en översikt över de grundläggande testaktiviteterna:

- Planering och kontroll:

- Planering

- Identifiera aktiviteter och resurser för att nå teststrategins mål

- Identifiera metoder för att samla in mätetal

- Bestäm testansats, testnivåer och testtekniker

- Förstå relation mellan testbas (krav), testvillkor och testfall

- Bestäm vad som ingår och inte ingår i testscope

- Specificera testmiljö och identifiera resursbehov/-begränsningar

- Identifiera externa beroenden

- Kontroll

- Ta fram testschema med milstolpar att mäta mot

- Anpassa rapportering av mätetal till intressenters behov

- Jämför utfall mot plan och agera vid behov

- Analys: Definiera vad som ska testas (testvillkor)

- Basera på testbas, testmål eller produktrisk

- Spåra bakåt till testbas och framåt till testfall

- Bestäm detaljnivå baserat på testnivå, systemkomplexitet, verktyg etc.

- Balansera nytta mot tidsåtgång

- Design: Definiera hur du ska testa (testfall)

- Implementering: Organisera och prioritera tester

- Definiera testfall (indata och förväntat resultat) och testprocesser (teststeg)

- Verifiera testförutsättningar (miljö, data, inträdeskriterier etc.)

- Identifiera beroenden och ta fram schema för testexekvering

- Exekvering:

- Testare utför tester enligt testfall (samt ev. fria tester)

- Testledare vägleder testare och följer upp utförandet

- Utvärdering och rapportering: Säkra effektiva processer för insamling och rapportering av information

- Avslut:

- Kontrollera att alla testaktiviteter är klara

- Överlämna testmaterial (defektlistor, testmiljöer, testfall etc.)

- Håll utvärderingsmöten och identifiera förbättringsmöjligheter

- Arkivera resultat, planer och rapporter

Det här kapitlet utvecklar testaktiviteterna från Foundation-nivån såtillvida att Analys och Design har blivit två separata aktiviteter och så också Implementering och Exekvering. Innehållet i aktiviteterna är dock vanligt förekommande på alla testprojekt. Jag har inte lett något testprojekt där jag INTE utfört allt detta så kapitlet är bra som en checklista inför ett nytt testprojekt. Den viktigaste aktiviteten för en testledare är planeringen, som lägger grunden för framgångsrika tester, och den får därför en egen del i kapitel 2.

|

Exempelfråga Vilket av följande påståenden är fel? A. Testexekvering börjar när inträdeskriterier är uppfyllda (eller uteslutna)

och slutar när utträdeskriterierna är uppfyllda.

Svar: B. Rapporter bör alltid anpassas till mottagaren. Till exempel är en intressent från verksamheten kanske inte intresserad av en teknisk felbeskrivning utan mer av vilken affärsprocess som påverkas och hur. |

2. Testledning

2.2 Testsammanhang

Kapitel två inleds med en översikt över det sammanhang som en testledare verkar i:

- Intressenter: Utvecklare (rättar defekter), chefer (ställer krav), projektledare (styr resurser), support (beroende av kvalitet), användare (beroende av system) etc.

- Projekt: Krav (styr testfall), projektledning (styr resurser), konfiguration och utveckling (styr tidplan), support (påverkas av defekter) etc.

- Metodik: Sekventiell (test av helhet), inkrementell (test av iterationer), agil (test parallellt med utveckling), spiral (test av prototyper) etc.

Sammanhanget styr också behovet av testnivåer, såsom de vanliga enhets-, integrations-, system- och acceptanstesterna men också tester av hårdvara, interaktion mellan funktioner och integration med kundprodukter. För varje testnivå bör följande definieras:

- Testmål (hur definieras framgång?)

- Testinnehåll (vad ska testas?)

- Testbas (vad ska testerna mätas mot?)

- In- och utträdeskriterier (när börjar och slutar test?)

- Testleverabler (vilka rapporter och andra dokument ska produceras?)

- Testtekniker (hur ska testerna utföras?)

- Mätetal (hur ska testtäckning och -framgång mätas?)

- Testverktyg (vilka verktyg ska användas och hur?)

- Resurser (vilka resurser ska användas, både testare och testmiljö?)

- Ansvariga (inom och utom testteamet)

- Uppfyllande av krav och regler (inom och utom projektet)

Översikten avslutas med en diskussion kring alternativa tester:

- Icke-funktionella tester: Kostnader behöver vägas mot nytta

- Erfarenhetsbaserade ("fria") tester: Behöver kontrolleras så att täckning och repeterbarhet säkras, t ex särskilda sessioner med uppföljning

Kapitlet fångar det som är både utmanande och stimulerande med att vara testledare: att få arbeta i ett omfattande kontaktnät med många beroenden. Listorna ovan kan med fördel användas som checklistor för de saker som du som testledare bör förstå så tidigt som möjligt i ditt projekt. Om något skulle saknas är det än viktigare att du förstår vilka konsekvenser det får. Jag har t ex jobbat med tester där en tydlig testbas saknas. Det är då viktigt att engagera såväl utvecklare (för att förstå systemet och bygga testfall därefter) som användare (för att förstå förväntningar och bygga förväntade utfall därefter).

|

Exempelfråga Vilket av följande påståenden är fel? A. Testarbetet påverkas av (och påverkar) intressenter, projekt och metodik.

Svar: D. Erfarenhetsbaserade tester är fria tester som visserligen bör kontrolleras men som syftar till att hitta just sådana defekter som testprotokollen inte täcker. |

2.3 Riskbaserade tester

Nästa del av kapitlet diskuterar utmaningen i att prioritera tester. En ansats är riskbaserade tester, som fokuserar på produktrisker (snarare än projektrisker) genom följande aktiviteter:

- Riskidentifiering: Intervjuer, workshops, checklistor etc.

- Riskutvärdering:

- Sannolikhet för risk: Teknisk komplexitet, resursbegränsningar, ny lösning etc.

- Påverkan av risk: Affärsmässiga förluster, lagliga sanktioner, säkerhet etc.

- Riskmitigering: Ju högre risk, desto noggrannare test, kravgranskning etc.

- Riskhantering: Risker hanteras genom hela projektcykeln

Till de informella riskbaserade testerna hör utforskande tester, där testaren analyserar risker. Dessa riskerar dock att fokusera mer på sannolikhet än påverkan och på testarens kunskap snarare än övriga intressenters. Bättre är då de så kallade lättviktstekniker som kombinerar informella fördelar (flexibilitet) med formella fördelar (konsensus). Till dessa hör PRAM (Pragmatic Risk Analysis and Management), SST (Systematic Software Testing (SST) och PRisMa (Product Risk Management) med följande typiska egenskaper:

- Baserade på branscherfarenhet

- Involverar intressenter både från verksamhet och teknik

- Introducerade tidigt i projektet

- Riskanalys grund för testplan och testvillkor

- Använder endast sannolikhet och påverkan samt kvalitativa bedömningar

Till så kallade tungviktstekniker hör följande:

- "Hazard analysis": Identifierar underliggande orsaker till risker

- "Cost of exposure": Baserar riskutvärdering på sannolikhet, kostnad vid fel och kostnad för test

- "Failure Mode and Effect Analysis" (FMEA): Identifierar risker, orsaker och effekter

- "Quality Function Deployment" (QFD): Fokuserar på brister i förståelse för kundens krav

- "Fault Tree Analysis" (FTA): Analyserar grundorsaken till upptäckta eller tänkbara defekter

Riskbaserade testers framgång baseras på följande:

- Fler viktiga än oviktiga defekter hittade

- De flesta av de viktiga defekterna hittade tidigt

- Testresultat förklarade för intressenter i termer av risk

- Bortprioriterade tester kopplade till lägre risk än utförda tester

Utöver risk finns det andra kriterier för prioritering av tester:

- Kravbaserade tester:

- Granska och eliminera tvetydigheter

- Bryta ned krav i testvillkor

- Orsak-verkan-grafer för att täcka kombinationer av testvillkor

- Användarprofiler med blandning av användarfall, användare, input och output

- Checklistor för vad som ska testas och i vilken ordning

- Reaktiv testning där prioritering görs dynamiskt under test

Jag ska erkänna att jag är lite tveksam till riskbaserade tester. Konceptet låter bra men min erfarenhet är att kravbaserade tester med väl formulerade och prioriterade krav gör riskbaserade tester överflödiga. Om det finns risker som INTE är täckta av kraven så är det väl kraven det är fel på?

Däremot tror jag att själva risktänkandet är viktigt att ta med sig in i varje nytt projekt. Vilka risker står kunden inför? Den frågan kan enkla modeller som Porter's femkraftsmodell svara på. Vilka av dessa risker syftar det nya systemet till att bemöta? Svaren på den frågan underlättar kontakterna med intressenterna. Hur väl täcker systemkraven systemets syfte? Ta med dig den frågan till din kravgranskning. Du kommer att finna att testarbetet sedan inte bara blir lättare utan också roligare då du förstår mer om det sammanhang du tester i.

|

Exempelfråga En testledare har tillämpat riskbaserade tester för prioritering av tester. När testerna avslutas kommer hon fram till att flera viktiga defekter hittades tidigt medan andra mindre viktiga defekter inte hittades alls eftersom dessa tester bortprioriterats. Intressenterna från både IT och verksamheten har löpande under hela projektet bidragit till och fått information om vilka risker som testats men inte åsatt riskerna några kvantitativa värderingar. Vad borde testledaren ha gjort annorlunda? A. Hon borde ha arbetat mer med att identifiera risker, t ex genom att involvera fler intressenter.

Svar: D. Hon har identifierat risker genom att involvera intressenter både från IT och verksamhet. Riskutvärdering ska baseras på sannolikhet och påverkan samt kvalitativa bedömningar, inte kvantitativa. Orsak-verkan-grafer är bra men används i kravbaserade tester, inte riskbaserade tester. |

2.4 Testleverabler

ISTQB definierar sex huvudsakliga testdokument:

- Testpolicy: Organisationens mål för test, inklusive testprocess och testförbättringar

- Teststrategi: Organisationens metoder för test

- Analytisk: T ex riskbaserade tester

- Modellbaserad: T ex operationell profilering (modell av verkligheten)

- Metodisk: T ex egenskapsbaserade tester (förutbestsämda testvillkor, checklistor etc.)

- Process: T ex tester enligt regelverk

- Reaktiv: T ex utforskande tester där tester designas under exekvering

- Konsultativ: T ex användarstyrda tester där intressenter tillhandahåller testvillkor

- Regressionsundvikande: T ex automatiserade tester

- Projekttestplan: Implementering av teststrategi för ett specifikt projekt

- Testinnehåll (vad ska testas och inte testas)

- Testschema (tid och resurser)

- Testcykler (relaterade till systemleveranser)

- Leverabler (relaterade till andra delar av projektet)

- In- och utträdeskriterier

- Risker

- Styrning

- Ansvar

- In- och utdata för varje testnivå

- Nivåtestplan: Testaktiviteter för en specifik testnivå (systemtest etc.)

- Riskhantering: Hantering av testspecifika risker som tillgång till miljö, testare och metoder

- Mitigering: Minskar sannolikhet för risk

- Beredskap ("contingency"): Minskar påverkan av risk

- Transferering: Överföring av risk till någon annan

- Acceptering: Hantering av konsekvenser

- Övrigt: Testfall etc. som skapas av testanalytiker men kontrolleras av testledaren

- Etablera mätetal för att kontrollera kvalitet

- Arbeta med testanalytiker för att välja lämpliga mallar

- Arbeta med testanalytiker för att etablera standarder

- Granska testprodukter tillsammans med intressenter

För certifieringsexamen är det viktigt att kunna skilja på ovanstående dokument. I verkligheten är det dock viktigare att förstå vilka dokument och vilket innehåll som förväntas. Konsultbolag har ofta egna mallar att utgå från men inte ens mina kolleger känner igen dem utan har egna uppfattningar om hur de bör se ut och det gäller förstås i än högre grad kunden. Därmed inte sagt att man ska ignorera egna mallar utan använd dem som checklista och förbättra de föreslagna mallarna vid behov. Det finns ingen mall som täcker alla tänkbara behov så egna initiativ är alltid uppskattade.

|

Exempelfråga Matcha nedanstående testdokument med innehåll A. Testpolicy.

1. "Prestandatesterna ska genomföras i en produktionslik miljö."

Svar: A-2, B-3, C-4, D-1. En testpolicy definierar organisationens mål med och kvalitetskrav på test. Riskbaserade tester är en testmetod och sådana definieras av teststrategin. Förutsättningar för teststart kallas inträdeskriterier och sådana definieras av projekttestplanen. Nivåtestplanen slutligen detaljerar aktiviteter för specifika testnivåer, t ex prestandatest. |

2.5-2.6 Estimering och mätetal

Estimering är svårt och det gäller inte minst test med alla dess beroenden:

- Önskad kvalitetsnivå på systemet

- Storlek på systemet

- Statistik från tidigare tester

- Processfaktorer som teststrategi, testmognad etc.

- Materiella faktorer som testverktyg, testmiljö etc.

- Mänskliga faktorer som ledarskap, erfarenhet etc.

- Komplexitet i processer, teknik, organisation etc.

- Uppstarts- och träningsbehov

- Utveckling av nya tekniker och verktyg

- Krav på detaljerad testspecifikation

- Känslig testdata (t ex tidskänslig)

Metoder för estimering inkluderar intuition, nedbrytning (WBS), standarder, historik och relationer till andra nyckeltal (projekttid, antal utvecklare etc.).

Vad gäller mätning av test så anger ISTQB fyra kategorier:

- Projekt: Utfall mot projektets utträdeskriterier

- Produkt: Testtäckning, defektdensitet etc.

- Process: Andel defekter upptäckta under test etc.

- Människor: Färdigställande av testfall etc.

För testledaren gäller det att definiera, fånga upp, validera och rapportera mätetal på ett sätt som är effektivt och rättvisande. Förutom rapportering så används mätetalen också till analys av trender och kontroll av korrigeringar.

Mätetalen kan spegla fem huvudsakliga dimensioner:

- Produktrisk: Andel risker täckta av godkända test etc.

- Defekter: Antal funna och rättade defekter etc.

- Test: Godkända och underkända testfall etc.

- Täckning: Andel av testfall täckta krav, risker etc.

- Förtroende: Mäts genom enkäter eller subjektiva bedömningar

I tillägg till dessa kan mätetal också knytas till testaktivitet, t ex mått av kravtäckning under testplanering antal testvillkor identifierade under testanalys.

Att estimera test motsätter lite syftet med test. I den perfekta av världar ska ju test utföras till kvalitetskraven uppnås, inte tills tiden tar slut. Men världen är ju som sagt inte perfekt och tid är ofta en orubblig begränsning. I mina estimeringar försöker jag utgå från systemets komplexitet, bryta ned det i testbara delar och väga in komplexitet. Här är dialogen med utvecklarna oerhört viktig då de inledningsvis vet mest om systemet. Därefter kan övriga "mjuka" faktorer på ISTQB:s lista vägas in. För att lyckas med detta är förväntningar oerhört viktiga, både dina (t ex på resurser och testmiljö) och andras (t ex krav på testdokumentation och stöd i andra delar av projektet). Se till att få dessa dokumenterade och godkända! Det svåraste att estimera, och som av någon anledning inte nämns av ISTQB, är kvaliteten på det som ska testas. Det hjälper inte hur bra testerna är planerade om de blockeras gång på gång p g a dålig kvalitet. Tyvärr är kvaliteten svår att estimera så räkna med att behöva testa i minst tre rundor (med en rejäl ledtid för initiala problem innan testerna kommer igång ordentligt) och lär av erfarenheterna till nästa testcykel.

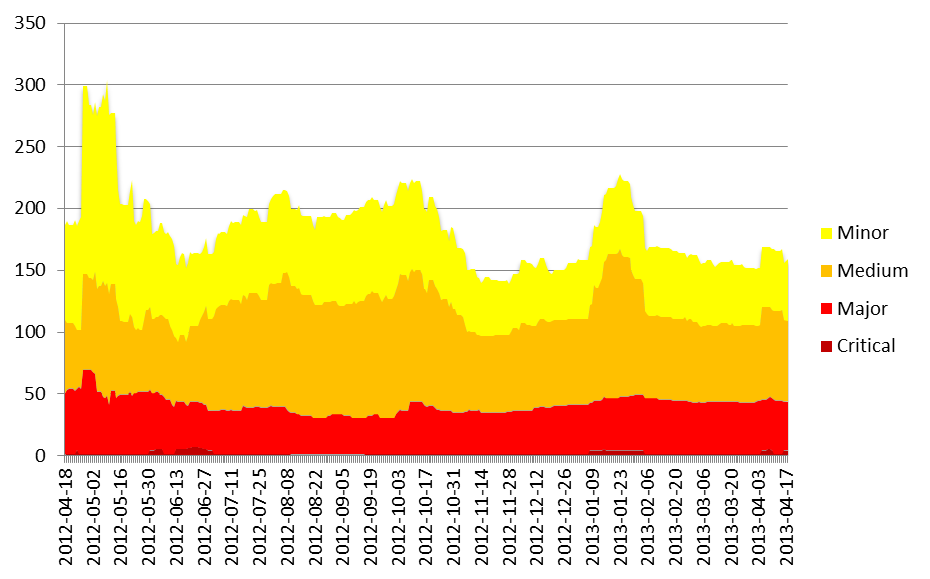

Vad mätetal beträffar så är det viktigt att också förväntningarna på dessa klargörs. Om inga förväntningar finns (vilket är så vanligt att jag ofta undrar om någon läser min testrapport) så välj ut några som ger dig som testledare en bra bild av testerna. Se senare beskrivning av testverktyg för mina favoritmätetal och hur jag fångar dem under test. Mätetalens syfte är trots allt inte att göra snygga grafer efter testerna utan att analysera och reagera på under testerna.

|

Exempelfråga Matcha nedanstående mätetal med dimension A. Andel krav som har testfall kopplade till sig.

1. Produktrisk

Svar: A-4, B-1, C-3, D-2. Koppling mellan testfall och krav mäter kravtäckning. Ju fler risker vars testfall misslyckas, desto större produktrisk. Ett av flera mått på testeffektivitet är hur mycket tid som verkligen kan användas till test och hur mycket som går till annat (väntetid etc.). Defekter i sig (typ av defekt etc.) är grunden för många mätetal men också rättningstid är viktig att följa. |

2.7-2.9 Värde av test

De sista delkapitlen i kapitel 2 diskuterar värdet av test, såväl det kvantitativa (hitta eller åtminstone identifiera defekter före driftsättning) som det kvalitativa (förbättrat rykte, minskade risker etc.). Ett begrepp i sammanhanget är kvalitetskostnad:

- Kostnad för förebyggande: Träning av utvecklare etc.

- Kostnad för upptäckande: Tid för kravgranskning, testfallsskrivande etc.

- Kostnad för internt misslyckande: Defekträttning etc. före driftsättning

- Kostnad för externt misslyckande: Supportkostnad etc. efter driftsättning

Om kostnaden för externt misslyckande är högre än de för upptäckande och internt misslyckande (typiska testkostnader) så kan test påvisas vara lönsamt.

Delkapitlen fortsätter med att diskutera distribuerade tester (test av anställda på olika platser), utlokaliserade tester (test av utomstående på olika platser) och inlokaliserade tester (test av utomstående på samma plats som projektet). För att lyckas med dylika tester krävs väldefinierad kommunikation, samordning av metodologi, tydliga förväntningar samt ömsesidigt förtroende.

Delkapitlen avslutas med en översikt över standarder som en testledare bör känna till:

- Internationella: ISO (International Organization for Standardization), IEEE (Institute of Electrical and Electronics Engineers) etc.

- Nationella: BS 7925-2 (brittisk standard för systemutveckling)

- Domänspecifika: DO-178B/ED 12B (USA:s respektive EU:s standarder för mjukvara i flygindustrin)

Test kan också påverkas av standarder inom mjukvarutveckling (t ex CMMI:s processområden verifiering och validering) eller projektledning (t ex PMI, PMBOK och PRINCE2).

3. Granskningar

Kapitel tre tar upp granskningar, en typ av statisk test i syfte att eliminera fel innan de implementeras och når de dynamiska testerna.

- Informella granskningar

- Genomgångar

- Tekniska granskningar

- Inspektioner

- Ledningsgranskningar (uppföljning mot plan)

- Revisioner (granskning av regeluppfyllande)

Granskningar utförs lämpligen i samband med milstenar, t ex färdigställande av krav. Planeringen bör omfatta vad som ska granskas, av vem samt vilka risker som ska täckas. Insatsen för granskningar kan vägas mot kostnaden för att avstå (se kvalitetskostnad ovan). Mätetal kan användas för att utvärdera det granskade objektets kvalitet samt kostnader och fördelar med granskningen. För mer formella granskningar används definierade in- och utträdeskriterier, checklistor, överenskomna leverabler samt mätetal - som den typiska testprocessen alltså.

Jag håller inte riktigt med om att granskningar ska utföras i samband med milstenar eftersom felen då hittas försent. Som testare vill jag inte vänta ytterligare på kraven tills granskningarna genomförts. Bättre då att bygga in löpande granskningar allt eftersom kraven fastställts. Vad formella granskningar beträffar så har alla jag varit med om slutat på samma sätt - jag presenterar hur mina tester dokumentation och hör sedan aldrig av granskarna igen. Förhoppningsvis betyder det att de varit nöjda men det vore trevligt att få återkoppling och använda granskningsresultaten så som de är tänkta att användas - till förbättringar.

|

Exempelfråga Matcha nedanstående mätetal med granskningsobjekt A. Antal granskare.

1. Produkt

Svar: A-3, B-4, C-2, D-1. Antal personer som tas från andra projektuppgifter utgör en kostnad som får vägas mot fördelen av att hitta defekter tidigare. Ju fler objekt som de hinner granska desto bättre (jämför mätetalet utförda testfall / planerade testfall). Defekters typ ger en indikation på granskningsobjektets kvalitet. |

4. Defekthantering

Kapitel fyra diskuterar hanteringen av avvikelser, när de väl upptäckts. En skillnad görs mellan "falsk-positiva" felrapporter (som visar sig inte vara defekter) och "falsk-negativa" (defekter som aldrig blir felrapporterade). De förra påverkar testeffektiviteten medan de senare påverkar upptäcktseffektiviteten och försök att minska den ena ökar i regel den andra.

- Initialt: Testare samlar in information om avvikelsen för rapportering

- Återlämnande: Testare ombeds lämna mer information om avvikelsen

- Bekräftelse: Testare ombeds testa om avvikelsen

En defektrapport bör ge information för hantering av defekten, utvärdering av projektstatus (produktkvalitet, testpåverkan etc.) samt utvärdering av processförmåga (förmåga att förbättra test- och rättningsprocess etc.)

- Upptäckare och roll (testare, utvecklare etc.)

- Ägare

- Projekt och produkt

- Testtyp (systemtest, prestandatest, regressionstest etc.)

- Beskrivning av defekt (sammanfattande och detaljerad)

- Steg för att återskapa defekten

- Den livscykel som defekten introducerats, upptäckts och åtgärdats i

- Den leverabel eller komponent som felet introducerats i (för orsaksanalys)

- Allvarlighetsgrad (teknisk påverkan) och prioritet (affärspåverkan)

- Identifieringsmetod (granskning, dynamisk test, drift etc.)

- Påverkan på kvalitetsegenskaper och intressenter

- Testmiljö

- Slutsats (beslut om rättning, alternativkostnad för att avstå etc.)

- Beskrivning av lösning

- Historik för defektens hantering i defektcykeln

Informationen i defektrapporterna kan användas för att förbättra testprocessen enligt följande:

- Introduktion för att effektivisera upptäckt och rättning i varje fas

- Introduktion för riktade åtgärder mot de mest defekttäta områdena

- Orsaksanalys för att förbättra processer

- Introduktion för att göra kvalitetsanalyser

- Defektanalys för att förstå tekniska risker (som grund för riskbaserade tester)

En bra defektprocess kräver såväl ett bra testverktyg (t ex ALM) som välinformerade användare (såväl testare som tekniker). SISU ("skit in skit ut") gäller i högsta grad defektstatistik så fundera före testerna vilken statistik du vill ha och skapa defektparametrarna därefter. Gör också en avvägning mellan de olika parametrarna och välj ut de viktigaste. Det är bättre att du får några väl ifyllda mätetal än många slarviga. Lyckas du med detta kan du få ut mer av defektprocessen än att "bara" rätta defekter.

|

Exempelfråga En testledare håller på att sammanfatta utestående defekter inför morgondagens testrapportmöte och upptäcker en allvarlig defekt som lämnats utan åtgärd. Av historiken att döma har ett flertal intressenter diskuterat defekten utan att kunna enas om ansvaret. Den sista noteringen refererar till ett möte som inte protokollförts. Vilken information hade hjälpt testledaren att motivera varför defekten varit öppen? A. Ägare (för att kunna peka ut ansvarig intressent)

Svar: C. Utestående defekter är i slutändan testledarens ansvar och kan inte skyllas på andra. Information om var defekten uppstått är intressant för kommande orsaksanalyser men förklarar inte varför defekten lämnats öppen. Eftersom defekten inte är löst hade lösningsinformation inte hjälpt (däremot en handlingsplan för lösning. Information om slutsats hade kunnat användas för att dokumentera mötets slutsats. Kanske har någon intressent bedömt att alternativkostnaden inte varit så hög för den här defekten och därför prioriterat ned den. Det viktiga i en testrapport är just konsekvenser och slutsatser av utestående defekter. |

5. Förbättra testprocessen

Mycket i det här kapitlet gås igenom i detalj i Expert Syllabus. Nivåmodeller som TMMi (Test Maturity Model Integration) och TPI Next jämförs med kontinuerliga modeller som STEP (Systematic Test and Evaluation Process) och CTP (Critical Testing Processes) De förra är processreferensmodeller, som inkluderar mognadsutvärderingar, medan de senare är innehållsreferensmodeller, som fokuserar på affärsdrivna utvärderingar.

- TMMi: 5 mognadsnivåer (Initial, Styrd, Definierad, Mätt, Optimerad)

- TPI Next: 4 mognadsnivåer (Initial, Kontrollerad, Effektiv, Optimerande

- CTP: 12 kritiska testprocesser som prioriteras enligt organisationens utmaningar

- STEP: Kravbaserade tester som inleds i början av projektcykeln och utförs med utvecklarna

Förbättringar grundar sig på Demings planeringscykel Planera-Gör-Kontrollera-Agera (Plan-Do-Check-Act). Mer specificerad är IDEAL-modellens cykel Initiera-Diagnosticera- Etablera-Agera-Lär.

Jag brukar inta en avslappnad attityd till metoder eftersom de är lite grann som trafikregler, det hjälper inte att du följer dem om ingen annan gör det. I stället använder jag dem som checklistor och inspirationskällor. Se till att du känner till begreppen, både till examen och i diskussioner med andra testledare, men låt dem inte fördunkla ditt eget omdöme. Dock har jag nyligen blivit medlem 1847 i TMMi Foundation så kanske ändrar jag uppfattning inom kort...

|

Exempelfråga Vilket av följande påståenden är fel? A. TMMi är en nivåmodell ("staged model")

Svar: D. Till skillnad från TMMi och TPI Next så utvärderar STEP inte mognadsnivåer. I stället fokuserar STEP, i likhet med cTP, på affärsdrivna utvärderingar, i STEPs fall på kravbaserade tester tidigt i projektcykeln. |

6. Testverktyg och -automatisering

Till testledarens uppgifter hör att välja ut testverktyg.

| Verktyg | Fördelar | Nackdelar | Överväganden |

| Open-source | Låg kostnad | Begränsad support För specifika Ej certifierade | Kontrollera licenskrav (t ex möjligheter att anpassa) |

| Anpassat | Uppfyller behov Kan ha bredare användning | Beroende av utvecklare | Designa och testa verktyget |

Precis som alla investeringar bör val av testverktyg baserat på en avkastningsanalys (ROI):

- Engångskostnader (inköp, integrering etc.)

- Återkommande kostnader (licens, underhåll etc.)

- Alternativkostnader (resurser som tas från test)

- Risker (organisationens mognad etc.)

- Fördelar (minskad exekveringstid, nya testområden som prestandatest etc.)

För valet bör testledaren beakta följande egenskaper:

- Analys: Kan verktyget användas enligt syftet?

- Design: Kan verktyget skapa testfall och testdata automatiskt?

- Data- och testval: Hur väljer verktyget testfall och testdata att köra?

- Exekvering: Kan verktyget köra testfall helt eller delvis automatiserat?

- Utvärdering: Hur utvärderar och rapporterar verktyget utfallet?

Vidare måste testledaren hantera alla faser i verktygets livscykel, d v s införskaffande, underhåll, vidareutveckling och utfasning. Avslutningsvis ska testledaren naturligtvis se till att verktyget utnyttjas fullt ut, inte minst vad gäller de mätetal som verktyget kan fånga upp.

Det här kapitlet är nog mer relevant för permanenta testledare än för konsulter som jag. De flesta organisationer man kommer till som konsult har redan ett testverktyg (företrädesvis ALM) som man får förhålla sig till. Det viktiga är då inte att välja utan att anpassa det som finns. Se till (kräv!) att få administratörsrättigheter och våga föreslå arbetssätt som utnyttjar verktyget till fullo.

|

Exempelfråga En ny testledare ska ta över efter en avgående testledare på ett medelstort företag med direktförsäljning till konsumenter. Testprocesser och -verktyg finns för de existerande systemen men företaget är mitt inne i införandet av en ny mobilapplikation som uppskattas ta över upp till 30% av omsättningen på sikt. Det gamla testverktyget är inte lämpat för denna typ av tester och testbudgeten är ansträngd men VD:n har via kontakter fått en prisvärd offert på från en extern firma specialiserad på mobila applikatiioner. Den nye testledaren känner till ett open source-verktyg men de kan bara användas för just mobilapplikationer. Den avgående testledaren har börjat utveckla ett anpassat verktyg och tror sig kunna få det klart i tid. Testarna har tid att ägna åt tester och ser fram emot att ge sig i kast med mobilapplikationen. Vilket alternativ ska testledaren välja? A. Open source

Svar: A. Att anpassa ett verktyg är riskabelt då den som utvecklar det är på väg att sluta. Ett standardverktyg vore önskvärt men varken budget eller tid ger utrymme för det. En extern tjänst vore ett alternativ för en punktinsats men då detta system förväntas få ökad betydelse bör testkompetens byggas internt. Open source-verktyget är både billigt och känt (av testledaren) medan alternativkostnaden för att använda det är låg (testarna har både tid och motivation att lära sig det. Att det är specifikt gör ingenting då övriga tester hanteras av befintliga verktyg. |

7. Testkunskaper och lagarbete

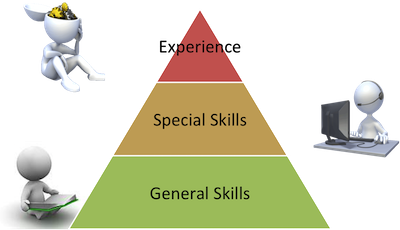

Det avslutande kapitlet tar upp testledarens medarbete - testarna. Följande färdigheter bör bedömas vid valet av testare:

- Användning av systemet

- Kunskap om verksamheten

- Erfarenhet av systemutvecklingsprocessen

- Erfarenhet av testaktiviteter

Utöver ovanstående tekniska färdigheter är interpersonliga färdigheter (kommunikation, samarbete etc.) viktiga för testarna. För testledaren tillkommer projektledningsfärdigheter (planering, rapportering etc.). För teamet som helhet gäller att färdigheterna matchar det specifika testprojektets behov samt att individuella styrkor och svagheter balanseras mot varandra. En utvärderingsmatris kan användas för att utvärdera medarbetarnas färdighetsnivå inom olika områden.

| Tekniska färdigheter | Interpersonliga färdigheter |

| Härleda test från krav | Presentera testresultat |

| Granska teknisk dokumentation | Förklara defektrapporter |

| Applicera testtekniker | Träna medarbetare |

| Förstå grundorsaker | Ge återkoppling |

| Använda testverktyg | |

| Modifiera testdata | |

| Automatisera tester |

Kapitlet fortsätter med en genomgång av själva testfunktionens olika beroendenivåer:

| Beroendenivå | Fördelar | Nackdelar |

| Inga oberoende testare (utvecklare testar egen kod) | Defekter rättas snabbt | Utvecklare avgör själv om kod fungerar |

| Utvecklare testar varandras kod | Defekter rättas snabbt | Litet oberoende, fokus på positiva tester |

| Testare ingår i utvecklingsteam | Tester utförs mot krav | Tid kan väga tyngre än kvalitet |

| Testare ingår i testorganisation | Tester fokuserar på kvalitet | |

| Externa testare utför tester | Tester utförs av områdesspecialister | Testare kan missa defekter utanför deras områden |

| Extern testorganistion utför tester | Maximalt oberoende tester | Tydliga krav och strukturerad kommunikation krävs |

Till en testledares uppgifter hör också att motivara testarna:

- Uppskattning av utfört jobb

- Erkännande av ledningen

- Respekt från team

- Ökat ansvar och självständighet

- Adekvata belöningar

Då test är beroende av så många andra delar av projektet är det viktigt att prestationerna mäts inte av projektets framgång utan att testspecifika mätetal. Det är därför viktigt att testledaren förmår motivera testarna även om projektet i stort har problem.

Avslutningsvis tar Advanced Syllabus upp vikten av god kommunikation:

- Dokumentation av testprodukter

- Återkoppling på granskade dokument

- Interaktion inom testteam och projekt

Diplomati och objektivitet är viktiga egenskaper i kommunikationen. Vidare måste kommunikationen vara effektiv (anpassad till målgruppen) och hänsyn tas till hur kommunikationen uppfattas.

Kapitlet tar upp viktiga aspekter av teamarbete som inte är specifika för test. Jag skulle vilja lägga till vikten av att förstå intressenters förväntningar också. Jag har nämligen jobbat med att sätta ihop testteam från CV:n och intervjuer där jag vinnlagt mig om att hitta en bra blandning av just tekniska färdigheter (funktionella, tekniska, manuella och automatiserade tester) som personliga (pådrivare, motiverare, utförare och granskare). När jag var klar tyckte jag att jag hade ett välbalanserat team, varpå kundens representant ändrade kraven så att jag fick börja om från början. Först senare förstod jag att orsaken var en dold agenda där representanten bevakade sina egna intressen och därför inte ville ha in testare från mitt företag.

Ett annat exempel på vikten av att förstå förväntningar utgjorde ett projekt där det interna teamet (utvecklare och projektledare) förväntade sig halvfärdiga komponenter efter varje iteration medan det externa teamet (kundrepresentanter) förväntade sig färdiga delar. De senare reagerade därför på de uppriktigt rapporterade defekterna och gav upphov till en hel del förtroendeproblem som hade kunnat undvikas om förväntningarna först jämkats ordentligt.

|

Exempelfråga Vilka av nedanstående testare kan förväntas utgöra ett välbalanserat team tillsammans? Teamet kan maximalt kosta 5 000 kr i timmen. A. En senior testare med gedigen erfarenhet av kravanalys, testtekniker och

orsaksanalys som inte tvekar att kritisera utvecklare (1 500 kr/tim)

Svar: B-D-E-G bildar ett välbalanserat team. A brister i interpersonliga färdigheter och detsamma gäller C. F riskerar att lämna projektet om bättre möjligheter dyker upp medan H visserligen är intresserad av test men har "fel" certifiering jämfört med G. Teamet B-D-E-G täcker in alla fyra områden systemanvändning, verksamhetskunskap, utvecklingserfarenhet och testerfarenhet. De kompletterar också varandra väl då B kan bidra inom tekniska tester och H inom funktionella medan D kan bidra till kravanalyser och E till kommunikation. |

Expert Level Syllabus - Test Manager

Låt oss fortsätta med att studera Expert Level Syllabus - Test Manager.

2. Förbättra testprocessen

Kapitel två diskuterar vikten av att förbättra testprocessen i tre sammanhang:

- Affärsmässiga och organisationella utmaningar: Kortare ledtider, kostnadspress, högre kvalitetskrav, utlokalisering etc. fordrar effektiv testning

- Underhåll av befintliga system: Mjukvaruystem ingår i helhet som omfattar t ex hårdvara och processer, vilket fordrar mer omfattande testning

- Test- och kvalitetsutmaningar: Kvalitetskrav är inte begränsade till mjukvarusystem och köpare förväntar sig kringtjänster, vilket fordrar en bredare syn på test och kvalitet

Det här är inga nyheter för mig som är van vid att test kläms mellan förseningar i föregående projektfaser och krav på att ändå leverera i tid. Det har också förekommit att jag tagit med mig den kunskap om systemet jag byggt upp under testerna för att ge förvaltningen stöd och då sett vådan av att inte tänka på det sammanhang som systemet ska fungera i. Det bästa råd jag kan ge är att hålla på integriteten och ständigt lyfta fram faran med att "ta sig genom en tunnel så snabbt som möjligt" men var beredd på att du måste stånga dig blodig för att lyckas med det.

Hur ska man då förbättra testprocessen? ISTQB talar om Software Process Improvement (SPI). Detta handlar just om att förbättringar av testprocessen måste omfatta mer än bara test, t ex infrastruktur, utbildning och andra projektfaser, såsom kravställande och utveckling.

Vidare diskuterar ISTQB fem typer av kvalitet: Produkt, Tillverkning, Användare, Värde och Överskridande ("Product", "Manufacturing", "User", "Value", "Transcendent"). Vilken typ av kvalitet som är viktigast beror på sammanhanget - säkerhetskritiska branscher föredrar produkt - och tillverkningskvalitet medan nöjesbranscher värderar användarmässiga och överskridande egenskaper högre.

Hur uppnår man då kvalitet? Ett svar som ISTQB ger är Deming-cykelns kontinuerliga förbättring i fem steg: Planera, Utföra, Kontrollera och Agera ("Plan", "Do", "Check", "Act"). En praktisering av detta är förbättringsramverket IDEAL (Initiera, Diagnosticera, Etablera, Agera, Lär). En annan är The Fundamental Concept of Excellence, som listar nio kriterier för kvalitet:

- Resultatorientering ("Results Orientation")

- Kundfokus ("Customer Focus")

- Ledarskap ("Leadership & Constancy of Purpose")

- Processer ("Management by Processes & Facts")

- Personalengagemang ("People Development & Processes")

- Kontinuerlig förbättring ("Continuous Learning")

- Ömsesidiga relationer ("Partnership Development")

- Socialt engagemang ("Corporate Social Responsibility")

Ytterligare begrepp som tas upp är Six Sigma (låg tolerans mot kvalitetsbrister), Balanced Scorecard (mätetal för helhetssyn) och CMMI eller Capability Maturity Model Integration (guide för systemförbättring). Du behöver inte kunna allt detta utantill utan det räcker att du känner till begreppen. De ligger sedan till grund för testspecifika modeller, såsom processmodellerna TMMi (Test Maturity Model Integrated) och TPI Next (Test Process Improvement) samt innehållsmodellerna STEP (The Systematic Test and Evalution Process) och CTP (Critical Testing Process). Dessa modeller gås igenom i detalj i kapitel 3.

Medan de modellbaserade ansatserna fokuserar på HUR man ska förbättra testprocessen så handlar analysbaserade ansatser om VAR man ska förbättra testprocessen. GQM (Goal-Question-Metric) är ett sådant exemple och flera gås igenom i detalj i kapitel 4.

Kapitlet avslutas med en uppräkning av konkreta exempel på testförbättrande åtgärder. Fundera gärna över exempel från din egen testvardag.

- Kunskaper: Vilka kunskaper har dina testare och vilka ytterligare behöver de? Jag har jobbat såväl med erfarna testare (som behöver kunskap om systemet och affärsprocesserna) som verksamhetsexperter (som behöver förståelse för testmetodik).

- Verktyg: Vilka testverktyg använder du och hur? Rätt använt kan ett testverktyg som ALM spara mycket tid. Om dina testare alltid kan se vad de ska göra och du alltid se hur det går kan möten ägnas åt viktigare saker än att gå igenom arbetsfördelning och status.

- Erfarenheter: Blev testerna perfekta? Antagligen inte så var ödmjuk och uppmuntra självkritik så att ni kan lära er testa ännu bättre nästa gång.

- Standarder: Vilka standarder berör testerna? Det behöver inte bara vara regelverk utan också t ex gemensamma processer och mallar. Projektet består antagligen av personer från många olika företag med olika "språk" men om ni följer ett gemensamt ramverk så underlättas kommunikationen.

- Resurser: Vilka resurser behövs för testerna. Finns det en konfigurationshanteringsplan för testmiljön? Finns det tydliga krav och specifikationer för testdata? Behöver specialister utanför testteamet konsulteras för att validera utfall? Sådana frågor måste ställas och besvaras i god tid.

|

Exempelfråga Vilket av följande påståenden är fel? A. Processmodeller anger hur man kan förbättra test steg för steg medan innehållsmodeller

anger specifika aktiviteter för att förbättra test

Svar: C. TMMi bygger visserligen på CMMI men det är en processmodell, inte en innehållsmodell. |

3. Modellbaserade förbättringar

Syftet med processmodeller är att identifiera mognadsnivåer och peka ut vägen dit. En mognadsnivå kan antingen vara stegvis ("staged") eller kontinuerlig ("continuous"). Ett exempel på den förra är TMMi (Test Maturity Model Integrated) som anger kritierier som alla måste vara uppfyllda för att en mognadsnivå ska anses uppnådd. De fem mognadsnivåerna är Initial, Managed, Defined, Management and Measurement och Optimization. Ett exempel på den senare TPI Next (Test Process Improvement) där enskilda kriterier kan väljas ut och olika mognadsnivåer i olika områden därmed uppnås.

Syftet med innehållsmodeller är att förbättra test genom best practices. Modellen STEP (Systematic Test and Evaluation Process) bygger på idén att test genomsyrar hela projektcykeln och i likhet med TPI Next kan enskilda projektfaser väljas ut och förbättras. CTP (Critical Testing Process) å andra sidan påminner mer om TMMi såtillvida att kritiska testprocesser identifieras och prioriterade rekommendationer för förbättringar ges. Såväl kvalitativa som kvantitativa nyckeltal är viktiga i denna modell.

Modeller och mognadsnivåer i all ära men de är svåra att använda i verkligheten. Jag har sett projekt där ambitiösa utvärderingar gjorts men sedan runnit ut i sanden eftersom mottagarna inte förmått ta till sig dem. Kanske beror det på att test fortfarande är en lite eftersatt disciplin inom systemutveckling och att testare kallas in först när det är dags att testa och alltså försent för att införa långsiktiga förbättringar? Däremot är testmodellerna, som så många andra modeller, bra att ha med sig som "verktygslådor" som man kan välja och vraka ur för att hitta dem som passar bäst till det specifika projektet.

ISTQB refererar till många standarder från IEEE som kan vara bra att hämta inspiration från. (De är dock inte gratis.)

- IEEE829: IEEE Standard for Software and System Test Documentation

- IEEE1044: IEEE Standard Classification for Software Anomalies

För förbättringar kopplade till verkliga problem är analyser lämpligare och om detta handlar nästa kapitel.

|

Exempelfråga Vilket av följande påståenden är fel? A. TMMi mäter mognadsnivå stegvis ("staged").

Svar: C. STEP står för Systematic Test Evaluation Process och kräver inte att förbättringar görs i en specifik ordning. |

4. Analysbaserade förbättringar

Analysbaserade förbättringar skiljer sig mot föregående kapitels modellbaserade förbättringar genom att de baseras på verkliga problem snarare än generiska processmodeller. Däremot kan de kompletteras med innehållsmodeller för att utvärdera förbättringarna.

Ett exempel på en analys är orsaksanalysen, som syftar till att identifiera grundproblemet snarare än symptomet.

- Orsak-effekt-diagram (Shikawa, "fiskben"): Effekterna skrivs till höger i diagrammet, varvid brainstorming används för att ange orsaker till vänster.

- Inspektion: En faciliterad diskussion hålls för att analysera utvalda defekter och identifiera övergripande trender. Varje defekt förses med följande:

- Defektbeskrivning: Beskrivning av defekten (inte symptomet)

- Orsakskategori: T ex kommunikation, förbiseende, kunskap, process etc.

- Orsaksbeskrivning: Beskrivning av orsak och ev. kedja av orsaker

- Grundorsak: Det moment där defekten uppstod (inte upptäcktes)

- Förslag för att eliminera orsaken: Dessa måste vara specifika och nåbara

- Standardklassificering av anomalier: Organisationsomfattande klassificering för att få fram statistik om var fel uppstår kontra var det upptäcks ("defektläckage") samt kostnaden för felet och rättningen.

En sådan här orsaksanalys kan vara ett mycket kraftfullt verktyg för att hitta och eliminera fel så tidigt som möjligt i ett projekt. Jag har dock stött på flera exempel där det missbrukas och avråder från följande:

- Övertydlighet: Defekter som ska rättas behöver bara förstås av utvecklaren, inte av andra intressenter. Ibland är dessutom utvecklaren bättre än testaren på att förstå en defekt utifrån ett symptom. Lägg därför hellre energi på att först upptäcka och rätta så många defekter som möjligt och sedan, när testomgången är över, detaljera utestående defekter och analysera utvalda defekter.

- Överanalys: I början av ett projekt är det naturligt med barnsjukdomar som alla är medvetna om. Att då analysera varje liten defekt är bara att slösa med tid och slå in öppna dörrar. Lägg hellre energi på att förankra bra grundprocesser för att sedan hitta de fall som processerna inte täcker.

- Pajkastning: Orsaksanalyser kan lätt användas till att ge andra skulden, i synnerhet om projektet består av aktörer från flera olika företag. Var därför ödmjuk och diplomatisk när du rapporterar orsaker och tänk på att orsaker ofta är en kombination av flera faktorer och ansvaret för dem därför delat.

- Revolution: Det ligger i projekts unika natur att det tar ett tag innan processer blir effektiva. Föreslå därför inte revolutionerande åtgärder som förstör mer än de förbättrar utan håll dig till just specifika och nåbara saker. (Om projektet verkligen skulle behöva en revolution - ja, då är det dåligt planerat från början och bör hellre läggas ned och planeras om från grunden.)

En annan analys är GQM (Goal-Question-Metric). Den bygger på att man utifrån bestämda mål (konceptuell nivå) härleder frågor (operationell nivå) som svarar på hur målen nås och nyckeltal (kvantitativ nivå) som ger svar på frågorna.

Som stöd för analysen föreslås flera nyckeltal:

- Testeffektivitet (Test Effectiveness)

- Upptäcktsgrad (DDP eller Defect Detection Percentage): Antal defekter / kända defekter

- Defektkvot efter driftsättning (Post-release Defect Rate): Antal defekter / kodrader i tusental

- Testkostnad (Test Efficiency / Cost)

- Kvalitetskostnad (Organizational Cost of Quality): Kostnad för test jämfört med kostnad för fel

- Kvalitetskvot (Cost of Quality Ratio): Kostnad för statisk test / kostnad för dynamisk test

- Tidig upptäckt (Early Defect Detection): Defekter upptäckta under enhets- och integrationstest / defekter upptäckta under system- och acceptanstest

- Relativ testkostnad (Relative Test Effort): Testkostnad / Projektkostnad

- Testeffektivitet (Test Efficiency): Defekters antal och allvarlighetsgrad / testkostnad

- Automationsnivå (Automation Level): Automatiserade testfall / totala testfall

- Testsproduktivitet (Test Productivity): Testfall / testkostnad

- Ledtider (Lead-time): Testtid för specifika faser

- Förutsägbarhet (Predictability):

- Förskjutningar i ledtid (Test Execution Lead-time Slippage): Skillnad mellan verklig och planerad testtid

- Förskjutningar i kostnad (Effort Slip): Skillnad mellan verkliga och planerade kostnader

- Förskjutningar i testfall (Test Case Slip): Skillnad mellan verkliga och planerade testfall

- Produktkvalitet (Product Quality):

- Kvalitetsattribut (Quality Attributes): Funktionalitet, reliabilitet, användbarhet, effektivitet, driftsmässighet, portabilitet etc.

- Täckningsindikatorer (Coverage Indicators): Testade krav / Totala krav

- Testmognad (Test Maturity): Mognadsnivå enligt modeller som TMMi eller TPI Next (se ovan)

|

Exempelfråga Vilket av följande alternativ anger enbart nyckeltal för testkostnad (Test Efficiency / Cost)? A. Defect Detection Percentage, Early Defect Detection och Post-release Defect Rate

Svar: D. I A så är Defect Detection Percentage och Post-release Defect Rate mått på testeffektivitet. I B så är Quality Attributes ett mått på produktkvalitet. I C så är Effort Slip ett mått på förutsägbarhet och Coverage Indicators ett mått på förutsägbarhet |

5. Välja rätt ansats för testförbättringar

Kapitel 5 fortsätter diskussionen om förbättringar med riktlinjer för vilka man ska välja:

| Process | Innehåll | Analys |

| Testprocess finns | Testprocess behövs | Specifika problem finns |

| Standardiseringsbehov styr | Affärsnytta styr | Enighet om förändringsbehov styr |

| Processmodeller accepteras | Anpassning önskvärd | Många intressenter inblandade |

Blandade ansatser kan också komma i fråga, t ex orsaksanalys för att uppnå en mognadsnivå enligt TMMi.

Som konsult gäller det att vara mycket lyhörd inför kundens krav och förutsättningar för att välja rätt i djungeln av förbättringsansatser. På ett projekt så hade ledningen idéer om standardiserade testprocesser medan mellancheferna såg mer till affärsnyttan för sitt område och användarna var fullt upptagna av sina omedelbara problem. Att jämka samman så olika förväntningar kräver ett stort mått av diplomati, pragmatism och tålamod.

|

Exempelfråga För vilket av följande scenarier passar en innehållsmodell bäst? A. Organisationen har en testprocess och vill kunna jämföra olika projekt

Svar: B. För A lämpar sig en processmodell bäst, för C en analys och för D en hybrid där analys används för en innehållsmodell med stegvisa förbättringar inom områden där affärsnytta kan uppnås. |

6. Genomföra testförbättringar

Kapitel 6 baseras på IDEAL-ramverket som introducerades i kapitel 2.

Initiera förbättringsprocessen

Initiera förbättringsprocessen består av följande moment:

- Etablera behov: Vilka behov har olika intressenter (ledning, användare, utvecklare, testare, förvaltning etc.)?

- Sätt mål: Etablera vision, sätt specifika mål och koppla förbättringar till affärsmål

- Sätt scope: Generella processer, testprocesser, testnivåer, projekt- eller organisationscentrerad

- Välj strategi: Se kapitel 5

- Påverka kultur: Ta hänsyn till kunskap, kultur och förändringsvilja (se vidare kapitel 7 och framåt)

(De olika momenten är beroende av val av ansats för testförbättringar, se kapitel 5.)

Diagnosticera nuläge

Diagnosticera nuläge består av följande moment:

- Planera utvärdering: Planera och schemalägg förberedelser, intervjuer, områden och återkoppling

- Förbered utvärdering: Analysera testdokument för att förstå nuläge och granska formalia

- Genomför intervjuer: Intervjua i positiv anda (se kapitel 7)

- Ge återkoppling: Bekräfta och ge överblick över erhållna svar

- Analysera resultat: Analysera resultatet enligt vald ansats

- Analytisk ansats:

- Systematiskt tänkande: Analysera relationer mellan system och processer för att identifiera stabila och förstärkande (positiva eller negativa) loopar

- Vändpunkter: Identifiera punktinsatser som kan bryta onda cirklar eller ge positiva kedjereaktioner

- Modellbaserad ansats: Jämför nuläge med målläge

- Analysera lösningsförslag (konsekvenser, begränsningar, prioriteringar etc.):

- Förutfattade meningar: Analys behövs ej men risk att missa grundorsaken

- Rekommenderade lösningar: Best practice men risk att missa grundorsaken

- Krav från intressenter: Tydligt fokus men risk att missa förbättring uteblir

- Lösningsanalys: Avvägning av för- och nackdelar men resurskrävande

- Rekommendera åtgärder: Vision, mål och slutsater (vad fungerar bra, vad kan förbättras?)

- Unik identifierare (för spårbarhet)

- Rekommendationens påverkan på mål

- Estimerad kostnad och nytta

- Tidplan

- Risker (t ex motstånd)

- Beroenden och antaganden

Etablera testförbättringsplan

Etablera testförbättringsplan består av följande moment:

- Sätt prioriteringar: Balansera kort- och långsiktiga förbättringar, ta hänsyn till risker och länka till mål

- Ta fram ansats för implementering:

- Top-down: Större scope, kräver att förväntningar hanteras

- Bottom-up: Mindre scope, ägarskap hos enskilda projektteam

- Planera förbättringar: Etablera nyckeltal, kombinera förbättringar, bestäm tidplan och resurser etc.

IDEAL-modellen skiljer på en långsiktig strategisk plan som integrerar testprocessförbättringar med övriga mjukvaruprocessförbättringar och en kortsiktig taktisk plan som fokuserar på test.

Agera för att implementera förbättringar

Agera för att implementera förbättringar består av följande moment:

- Välj och exekvera pilot: Ta hänsyn till realism, skalbarhet, påverkan på verksamhet och risker vid misslyckande

- Led och kontrollera förändringen: Mät nyckeltal mot mål och besluta om implementering

Lär från förbättringsprogram

Lär från förbättringsprogram består av följande moment:

- Analysera och validera (tillsammans med intressenter)

- Föreslå framtida lösningar (baserade på erfarenheter)

Ett exempel på hur det kan gå när IDEAL-modellen inte följs utgör ett projekt jag deltog i där ett strategiskt beslut om utlokalisering fattats över verksamhetens huvuden. Det första steget, initiering, hoppades därmed över i och med att det varken fanns behov av eller stöd för förbättringen och därmed inte heller någon organisation utöver projektet. Trots det gick vi vidare med diagnosticering och kunde då konstatera att verksamhetens mognadsnivå inte var tillräcklig för utlokalisering av testtjänster. Däremot kunde vi rikta in oss på ett specifikt behov av testautomatisering och styra in projektet på detta mer avgränsade men också mer accepterade spår.

Tyvärr visade sig detta vara svårt att etablera eftersom vår ansats gång på gång möttes av ointresse. Kanske berodde det på att nyckelresursen, kundens testledare, visade sig vara på väg bort från företaget. Likväl så pressades projektet vidare (prestige, behov av att visa upp resultat?) och vi agerade alltså genom att flyga in utländska testare utan att ha några tydliga uppgifter eller utpekade mottagare av deras arbete så de fick nöja sig med att hoppa in som tillfälliga testare där det behövdes.

Det säger sig självt att det inte fanns mycket att lära av detta men alla blev ändå nöjda: kundens strategiska beslut förverkligades, fler konsulttjänster såldes in och testarna fick erfarenheter, om än annorlunda sådana. Om inte annat så fanns det nu ett förbättringsbehov men då hade jag redan lämnat projektet...

|

Exempelfråga Matcha nedanstående steg i testförbättringsprocessen med övergripande aktiviteter enligt IDEAL-modellen: A. Initiera

1. Utvärdera nuvarande processer

Svar: A-3, B-1, C-4, D-2, E-5 |

7. Organisation, roller och färdigheter

Kapitel 7 introducerar begreppet testprocessgrupp, en permanent grupp bestående av specialister som förbättrar och följer upp problemområden i hela organisationen. IDEAL-modellen kompletterar med beskrivningar av hur grupper etableras på strategisk nivå ("Executive Council"), taktiskt nivå ("Management Steering Group") och problemspecifik nivå ("Technical Working Group"). För distribuerade organisationer är det viktigt att alla parter får information och möjlighet att återkoppla samt att hinder p g a kultur, tidszon etc. övervinns.

Kapitlet fortsätter med en uppräkning av de färdigheter som de två rollerna testprocessförbättrare och utvärdere behöver:

- Intervjuteknik (öppna, fråga lyssna, summera, kontrollera, stäng), som i sin tur kräver

- Emotionell intelligens (känna, utnyttja, förstå och hantera känslor)

- Transaktionsanalys (teorin om att människor är uppdelade i tre effektiva och tre ineffektiva människotyper)

- Naturligt barn: Spontana, behöver erkännande

- Vuxen: Logisk, arbetar med fakta

- Förälder: Bestämd men förstående

- Kritisk förälder: Sätter folk på plats, verbalt och icke-verbalt

- Upproriskt barn: Negativ, motarbetande

- Lydigt barn: Försiktig, ger sig själv skulden

- Samberoende beteende (teorin om att folks vilja att göra sitt bästa döljer långsiktiga problem)

- Förmåga att lyssna

- Presentationsteknik (vinna stöd, visa resultat, föreslå förbättringar)

- Välj ut nyckelidéer

- Visa konkret hur idéer förverkligas

- Ha realistiska tidplaner

- Tala chefernas språk

- Förutse frågor

- Analytisk förmåga (sammanfatta, se mönster, omvandla information, skilja på orsak och verkan)

- Anteckningsteknik (mindmaps, nyckelord, diagram etc.)

- Övertalningsförmåga

- Sätt mål

- Välj målgrupp

- Välj ansats

- Fånga uppmärksamhet

- Känn ämnet

- Fråga om nästa steg

- Ledarskap (planering, estimering, beslutsfattande, riskhantering etc.)

Mycket av det som tas upp i det här kapitlet är nog självklart för de flesta med lite erfarenhet medan det för andra är för ytligt för att egentligen ge något stöd i det dagliga arbetet. Det jag ändå fäste mig mest vid var teorin om samberoende beteende. Hur ofta har jag inte själv befunnit mig i den situation som tas upp som exempel: att hantera orimliga testförutsättningar genom ett pragmatiskt förhållningssätt och helt enkelt testa så bra som möjligt.

Tyvärr ger kapitlet bara tips på hur man upptäcker samberoende beteende hos andra (svar som "Jag gör mitt bästa", "Det finns ingen risk", "Det här är normalt"), inte på vad man gör när man själv tvingas till det beteendet. Min erfarenhet är att det gäller att balansera den integritet mot pragmatism och lyfta fram långsiktiga risker utan att för den sakens skull framstå som en bromskloss. Själva testexekveringen kommer alltid att befinna sig sent i projektcykeln och du kan inte räkna med att få testa under ideala förutsättningar.

|

Exempelfråga Vilken av följande tekniker är INTE lämpliga för en testförbättrare A. Använd frågeformulär med tydliga ja- och nejfrågor.

Svar: A. Frågor bör vara öppna och genom aktivt lyssnande anpassas till diskussionen. Presentationer blir effektivare om man fokuserar på nyckelidéer och lägger detaljerna i appendix för dem som vill veta mer. Teknisk utrusning för inspelning kan göra den intervjuade mer försiktig och t o m en bärbar dator kan upplevas som en barriär. |

8. Hantera förändring

Kapitel 8 diskuterar utmaningen att hantera en förändring. Den grundläggande förändringsprocessen består av åtta steg som kan appliceras också på testförändringar:

- Skapa en känsla av brådska: Etablera förändringsbehov och tydliggör förändringar och tidplaner

- Sätt ihop ett vägledande team: Engagera entusiaster som "multiplicerare" (personer som först får kunskap och motiverar andra)

- Utveckla förändringsvision: Hantera förväntningar och etablera strategi

- Kommunicera: Informera, åskådliggör och motivera

- Bemyndiga andra: Ge stöd för förändringar och och möjlighet till återkopplingar för dem som påverkas

- Skapa kortsiktiga fördelar: Implementera och använd som motivering

- Ge inte upp: Låt förbättringsteam stödja strategier

- Skapa ny kultur: Förändra gradvis, publicera framgångar och följ upp problem

Kapitlet fortsätter med de mänskliga faktorerna i förändringsprocessen och beskriver två modeller som följer "forming-storming-norming-performing"-modellen (idén att förändringar genomgår kaos innan förbättringar uppnås:

- Satir: Gammalt status quo-Främmande element-Kaos-Transformering av idéer-Integration-Nytt status quo

- Kübler-Ross: Lättnad-Chock-Förnekelse-Ilska-Köpslagan-Depression-Acceptans-Experiment-Upptäckt

Avslutningsvis listas ett antal faktorer att ta hänsyn till för att hantera emotionella reaktioner på förändringar:

- Individuella förutsättningar

- Motivation till förändring

- Attityd till förändring

- Föregångare eller efterförljare ("early adopter" eller "late adopter")

- Acceptans för experiment och misslyckanden på vägen

- Inlärningsstil

- Preferens för beprövade eller nya metoder

Inte heller detta kapitel torde innehålla så många nyheter. Det finns dock många exempel på hur också de bästa intentionerna misslyckas därför att förändringarna inte hanterats rätt så vikten av detta kan inte nog betonas.

Som testare har man ofta en unik position nära såväl leverantören av ett system som mottagaren av detsamma och därmed möjlighet att fånga upp brister i förändringshanteringen. I ett av mina första testprojekt befann jag mig i en sådan position där systemutvecklarna kämpade för att få ett supportsystem att fungera rent tekniskt medan processutvecklarna ritade diagram på en alldeles för hög nivå. Den första versionen till användarna var således ett system där de förväntades faxa (!) supportuppgifter utan någon rutin för hur supportärendet skulle behandlas. Redan då försökte jag hålla på min integritet och lyfta fram de brister jag såg, inte så mycket i system och process som i hur de stackars användarna behandlades. Tyvärr var jag för junior för att få gehör men jag kan åtminstone känna stolthet över att jag försökte.

|

Exempelfråga En organisation har genom att analysera nyckeltal identifierat långa ledtider i sin systemutvecklingsprocess. En serie workshops har hållits där ineffektiva arbetssätt utpekats som orsaken och ledningen har därför tagit fram en förändringsvision. En av flera omedelbara förbättringar är införandet av ett testsystem. Systemet ersätter de nuvarande handskrivna testprotokollen och har därför välkomnats av användarna, trots de initiala problem som kan förväntas. Vid en uppföljning visar det sig dock att användarna inte tycker att testsystemet uppfyller deras behov och därför återgått till de handskrivna testprotokollen. Vilken är den troligaste anledningen? A. Man har inte satt förutsättningarna och bestämt vad som ska göras (steg 1-3 i förändringsprocessen)

Svar: B. A är fel då förutsättningarna är satta i och med de identifierade problemen och den framtagna visioinen. C är fel då användarna är förberedda på främmande element och kaos och D är fel då användarna välkomnar förändringen. Problemet ligger i att förändringarna inte permanentats. Kanske har inte användarnas motiv beaktats (kommunikation) eller kanske har de inte fått möjlighet att ge återkoppling (bemyndigande). Lyckligtvis har ledningen ändå gjort en uppföljning (skapa ny kultur) så hopp om framgång finns trots allt. |

9. Kritiska framgångsfaktorer

I tillägg till förändringshantering finns det ytterligare två nyckelfaktorer för att lyckas med testförbättring: att börja och att sluta.

Att börja innebär att man ska ha tydliga mål, stöd från ledningen, formell projektorganisation, dedikerade resurser, ambitioner mappade till organisationens mognad samt den tidigare nämnda förändringsprocessen.

Att sluta innebär att man ska ha förutsättningar för att uppfylla målen (min kategorisering):

- Cykler: Cykler för förbättringar, återkopplingar och mätningar

- Kontroll: Processägarskap och uppföljning av alla steg i förändringsprocessen

- Kunskap: Engagemang av testexperter samt vid behov intressenter med kunskap utanför test

- Organisation: Stabila projektteam och hantering av ovilja mot förändring

- Verktyg: Systemstöd, existerande processer, standarder etc.

- Samordning: Samordning mellan förbättringsinitiativ och synkronisering av mognadsnivåer

- Publicering: Demonstrering av framgång och godkännande av förbättringar

Kapitlet fortsätter med en genomgång av de kulturella sammanhang som behöver beaktas:

- Ledningskultur (kontrollerande, konsultativ eller team-driven)

- Nationell kultur

- Mål, strategi och attityd till förbättring

- Relationer mellan avdelningar

- Livscykelmodell (sekventiell, iterativ, agil, anpassad, ingen process)

- Testansats (automatisering, manuell, skriptad, utforskande, blandad, ad hoc)

Som exempel på testansats anförs det agila manifestet:

- Flexibilitet framför detaljerade processer

- Best practices framför mallar

- Implementeringsorientering framför processorientering

- Interna granskningar ("peer review") framför kvalitetsgranskningar ("Quality Assurance")

- Affärsdriven framför modelldriven

Som ISTQB mycket riktigt anger så kan en agil ansats vara svår att sälja in i "konservativ" organisation van vid detaljerade processer. Jag upplevde ett sådant projekt där förutsättningarna (avsaknad av krav, regelverk under utveckling, ny teknisk lösning) framtvingade en agil ansats i nära samarbete med verksamhetsexperter, såväl i utveckling som i test. Testfallen fick således fokusera på att kontrollera att data flödade genom lösningen medan utfallet fick bekräftas av dessa experter. På lägre nivåer fungerade detta alldeles utmärkt men ju högre upp i organisationen man kom, desto mindre var förståelsen för detta och vi fick kämpa mot krav på V-modellens dokumenterade design och mätbara tester och den mur som ständigt byggdes upp mellan projekt och verksamhet. Utmaningen här låg alltså inte i att sprida ledningens vision om förbättringar till verksamheten utan att få ledningen att förstå verksamhetens förbättringsbehov!

|

Exempelfråga Vilket av följande förbättringsprojekt har störst utsikt att lyckas? A. Ett ambitiöst projekt som siktar på att gå från lägsta till högsta mognadsnivå

och som engagerar hela organisationen.

Svar: B. Projekt A saknar såväl realistiska mål som begränsade cykler, även om det är bra att relationer byggs med alla intressenter. Att synkronisera mognadsnivåer som i projekt C är klokt men projektteam bör vara stabila och arbeta bra tillsammans. Externa konsulter kan bidra med specifik kunskap men bör inte som i projekt D ta fullt ansvar. Projekt B har ett lagom mål som tar vara såväl på den testkunskap som finns som organisationens övriga kompetens. |

10. Anpassning till olika livscykelmodeller

Det avslutande kapitlet diskuterar hur kulturella sammanhang (se föregående kapitel) påverkar val av förändringsmetod. Ledningskultur påverkar acceptans för ansats, livscykelmodell påverkar acceptans för förändringsfrekvens och testansats påverkar acceptans för förändringstyp. Det betyder dock inte att t ex agilt arbetssätt krockar med modellbaserade ansatser utan alla ansatser kan används som referenspunkter. Det viktiga är att förbättringen fokuserar på följande:

- Identifiera om livscykelmodellen rekommenderar en särskild förbättringsprocess

- Identifiera vilken förbättringsprocess som passar bäst i sammanhanget

- Identifiera vilken testansats som passar bäst i sammanhanget

Vad kapitlet alltså säger är att man ska anpassa teori till verklighet, vilket inte är en revolutionerande tanke. Den som har erfarenhet av systemutveckling vet att ingen metod utesluter idéer från andra metoder. Kapitlet pekar också på hur t ex V-modellens verifieringar och valideringar mellan faser påminner om SCRUMS retrospektiva möten genom att båda syftar till att identifiera förbättringar.

Jag har mest jobbat med V-modellen men ytterst sällan upplevt att en fas är helt avslutat innan nästa tar vid. Jag har därför fått jobba agilt med det som gått att jobba med och sedan återvänt och justerat i takt med att krav och design justeras. Projekt är av naturen föränderliga och lika viktigt som det är att mottagarna förmår hantera förändringar, lika viktigt är det att de som levererar gör det.

|

Exempelfråga Oaktat att förbättringsmetoder inte är specifika för särskilda livscykelmodeller, vilka arbetssätt hör bäst ihop med vilka sammanhang. Matcha metod och modell. A. Retrospektiva möten för att fånga upp återkopplingar och utföra förbättringar

Svar: A-3, B-1, C-2 |

The Expert Test Manager

Denna bok publiceras i april 2013 och jag hoppas kunna köpa och börja läsa den så snart som möjligt.

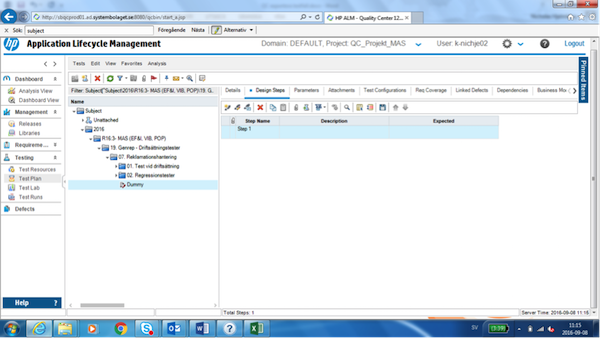

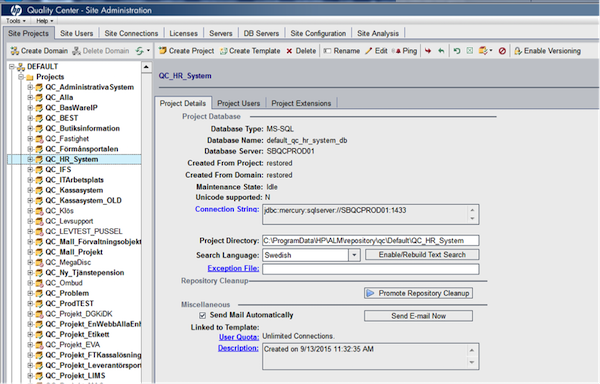

Quality Center / ALM

Säg testverktyg och de flesta testledare tänker nog på Quality Center, eller ALM (Application Life Cycle Management) som det numera heter. Syftet med denna sida är inte att berätta ALLT om ALM (det gör användarmanualen bättre) utan att ge tips om hur jag använder verktyget i mitt arbete. Förhoppningsvis hittar du något som hjälper också dig i ditt arbete.

Översikt

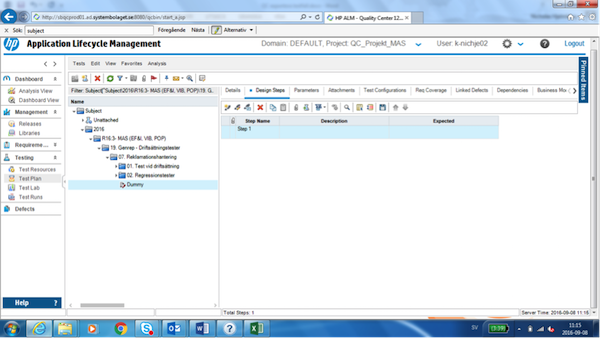

Quallity Center är i första hand ett administrativt verktyg som håller ordning på alla testdokument, deras inbördes relationer och status. Om du t ex vill skapa ett testfall så kan du göra följande:

- Skapa testfall och följa upp status (Test Plan/Details)

- Lägga till steg med handling och förväntat resultat (Test Plan/Design Steps)

- Lägga till parametrar (Test Plan/Parameters)

- Lägga till bilagor, t ex testdata (Test Plan/Attachments)

- Koppla till krav i Requirements (Test Plan/Req Coverage)

- Köra hur många gånger du vill (Test Lab)

- Följa upp testkörningar (Test Plan/Test Configurations)

- Skapa defekter (Defects)

- Koppla till defekter (Test Plan/Linked Defects)

- Granska i rapporter och diagram (Dashboard/Analysis View)

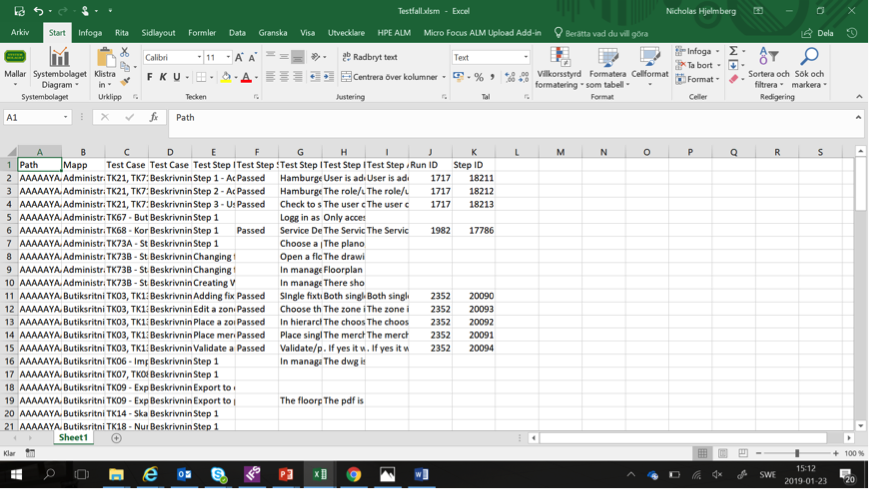

Bilden nedan ger en översikt över hur de olika delarna hänger ihop:

Hur gör man då för att få ihop alla dessa delar? Om detta handlar nästa kapitel.

Förbered ALM

När jag börjar på ett nytt testprojekt brukar jag sätta upp ALM enligt följande:

1. Bestäm filstruktur

ALM organiserar testdokument i mappar och filer precis som Filhanteraren i OS X eller Windows Explorer i Windows. Fundera därför på hur ditt testprojekt bäst bryts ned i logiska delar och organisera mapparna därefter. Somliga föredrar enhetliga filstrukturer genom hela ALM så att testarna alltid ska känna igen sig när man navigerar. Jag föredrar dock att också andra än testarna ska känna igen sina delar och organiserar enligt följande:

- Requirements (affärsstruktur): Mappar för kravområden och krav för enskilda krav. Om testvillkor används kan dessa skapas som underkrav. Numrera kraven så som de numreras i underliggande kravdokumentation och överväg att importera dem till ALM.

- Test Plan (systemstruktur): Mappar för systemområden och testfall för enskilda komponenter eller moduler. Numrera testfallen så som de numreras i underliggande designdokumentation.

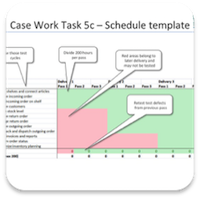

- Test Lab (teststruktur): Mappar för testfaser och test set för testscenarier, till vilka enskilda testfall kopplas. Numrera varje testset så som de numreras i testplaner.

En sådan filstruktur kan se ut enligt följande:

- Requirements: Ekonomi, Försäljning, IT etc.

- Test Plan: ETL-jobb, Beräkningar, Rapporter etc.

- Test Lab: Systemtest / Iteration 1, Systemtest / Iteration 2 etc.

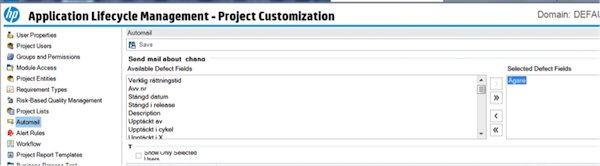

2. Förbered för mätetal

Välj vilka mätetal du vill ha och gör vad som krävs för att få underlag till dessa mätetal. ALM har många olika kolumner som kan användas (och anpassas i Tools / Customize / Project Lists). Välj inte för många mätetal - ingen användare blir glad av att ange femtioelva parametrar varje gång något ska registreras och ju fler parametrar som missas, desto sämre blir dina mätetal.

Här är några mätetal jag ofta använder med tillhörande parametrar i ALM. Bryt gärna ner dem ytterligare på funktionellt område etc. så att du lättare kan rikta in förebyggande och/eller förbättrande åtgärder.

| Mätetal | Beräkning | Fält i QC |

| Testtäckning | Testtäckta krav / Summa krav | Länk mellan krav och testfall Requirements / Test Coverage |

| Testskrivande | Godkända testfall / Planerade testfall | Test Plan / Status (sett över tid) |

| Allvarlighetsgrad | Antal defekter per allvarlighet | Defects / Severity |

| Orsaksanalys | Antal defekter per orsak | Defects / Detected in |

| Trend utförda test | Utförda testfall / Planerade testfall | Test Lab / Status <> No Run (sett över tid) |

| Trend godkända test | Godkända testfall / Utförda testfall | Test Lab / Status = Pass (sett över tid) |

| Trend upptäckta defekter | Öppnade defekter / Utförda testfall | Defects Defects, Test Lab / Status <> No Run (sett över tid) |

| Defektålder | Öppna defekter per ålder och allvarlighetsgrad | Defects / Status = Not Closed, Severity, Datum (exportera till Excel för beräkning av ålder) |

| Defektkö | Öppna defekter per dag och status | Defects / Status (sett över tid) |

| Trend stängda defekter | Stängda defekter per dag / Totalt antal defekter | Defects / Status = Closed (sett över tid) |

| Testeffektivitet | Antal defekter per testfas / Totalt antal defekter | Defects / Detected in |

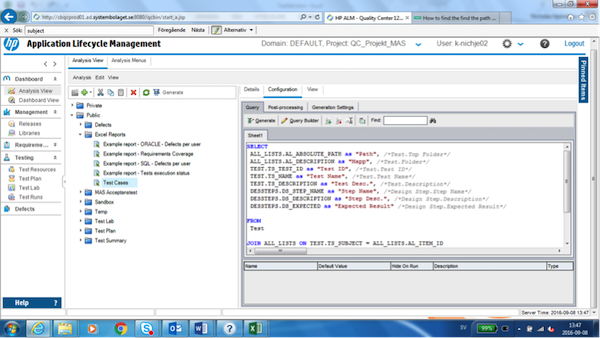

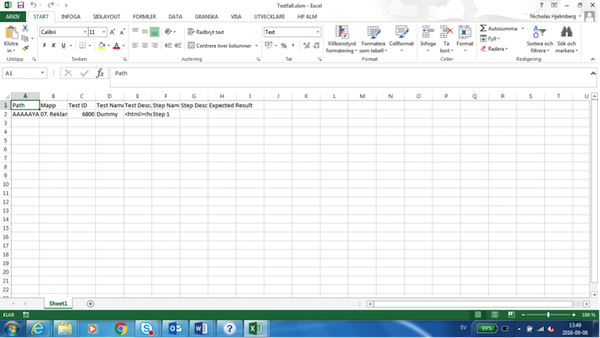

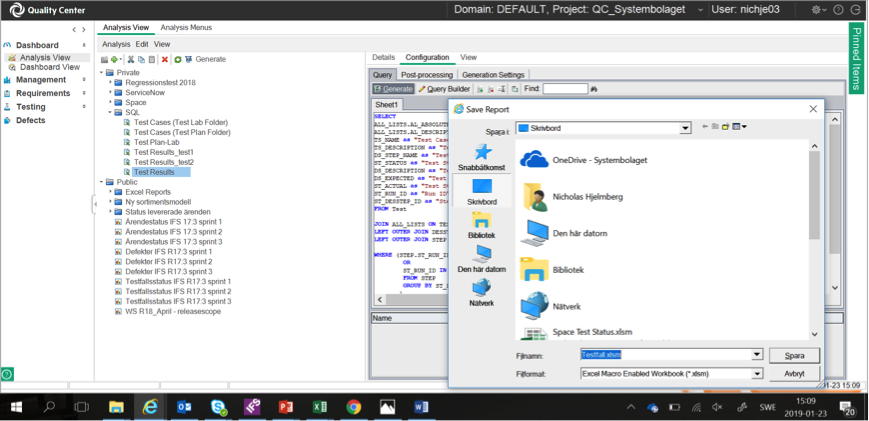

För att sedan fånga upp dessa mätetal brukar jag använda mig av grafer:

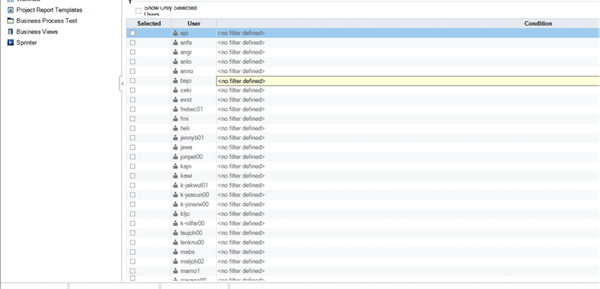

3. Informera användarna

Hur perfekt uppsatt ditt ALM än är så hjälper det inte om det bara är du som vet det. Se till att dina användare (såväl testare som utvecklare) vet vilka som ska användas och hur. Jag är en vän av processbilder kompletterade med skärmdumpar som visar ett testfalls väg från skapande via defekträttning till godkänt. Var särskilt noga med att klargöra överlämningspunkter mellan test och utveckling (tilldelning av ärenden, beskrivning av defekter och rättning, ändring av status etc.) så att inget faller mellan stolarna. En test- och defektprocess bör innehålla följande steg (men tänk på att anpassa den till ditt specifika projekts processer):

- Testledare lägger in krav i Requirements

- Testare tilldelas krav och skriver testfall i Test Plan

- Testledare granskar testfall och godkänner dem i Test Plan

- Testledare organiserar testfall i Test Lab

- Testare tilldelas tester och kör dem i Test Lab

- Testare loggar defekter i Test Lab och tilldelar dem till utvecklare